Este texto é uma adaptação de uma apresentação realizada na escola onde leccionei este ano e pretende responder a 3 questões: 1) A IA já está por todo o lado? 2) O que será um cenário disruptivo da IA? — percepção vs. realidade; capacidades e riscos da IA — 3) Na escola, o que Fazer? — sugestões práticas.

Caso seja relevante, este texto será alterado para incluir melhorias ou actualizações.

Índice

A IA já está por todo o lado?

O que será um cenário disruptivo da IA?

Percepção da disrupção

Realidade da disrupção

Capacidade da IA

Riscos da IA

Na Escola, o que fazer?

Sugestões Práticas para a Promoção do Bem-Estar na Comunidade Escolar

1. Participação e Envolvimento da Comunidade

2. Avaliação do bem-estar

3. Actividades promotoras de bem-estar

4. Página do SPO no site da escola

Actualizações

A IA já está por todo o lado? ▲

É possível que muitas vezes nem nos ocorra até que ponto a Inteligência Artificial já se encontra disseminada. Talvez, então, a melhor forma de percebermos a sua silenciosa omnipresença seja imaginar o que aconteceria se, de repente, a IA deixasse de existir.

Quantas das nossas dúvidas ficariam por responder sem esta enciclopédia que fala connosco? Como é que o motorista da visita de estudo teria encontrado o melhor caminho? Ou então nós, como teríamos descoberto lá o único restaurante vegano sem a sugestão do Google? E quem me avisaria se o meu cartão multibanco estivesse a pagar um jantar do outro lado do mundo? E na escola? O que seria voltar a preparar aulas, fazer e corrigir testes, e até avaliá-los só com um caderninho, perante tantas exigências de rigor e de ensino personalizado?

Seria eu melhor professor se me sobrasse mais tempo para ler um livro, se as redes sociais não me obrigassem a passar lá tanto tempo? Onde iria eu buscar esses sucessivos picos de dopamina alimentados pela controvérsia, o medo e o ódio? Talvez na satisfação de ver a rapidez dos textos sugeridos para os inúmeros e-mails a que não quero responder, ou para as actas intermináveis das reuniões complicadas em que preferia não ter estado? Afinal de contas, será que ainda sei escrever sem ajuda?

Enquanto faço uma pausa para afiar o lápis para escrever o próximo parágrafo (leia-se: enquanto peço ajuda ao ChatGPT!), ocorre-me que todas estas questões comezinhas empalidecem perante a catadupa de acontecimentos se a IA — cada vez mais integrada em sistemas de infra-estruturas críticas —, de repente, desaparecesse: primeiro um “apagão” total, depois a queda dos mercados mundiais, a disrupção das cadeias de abastecimento, o colapso dos sistemas de saúde e transporte, e tudo mais intensificado pelo pânico de quem não tem como saber o que que se está a passar… isto à escala do planeta, no limite, poderia até provocar uma catástrofe maior do que uma guerra nuclear!

Mas, calma…este cenário é bastante implausivel, por partir do desaparecimento da IA, como por magia, em todo lado e ao mesmo tempo!

Este exemplo serve sobretudo para reflectirmos sobre a seguinte questão: nós podemos concentrar-nos nos tremendos benefícios de um transplante de um coração artificial e, ainda assim, também temos boas razões para garantir que este não falha nem prejudica a nossa saúde. Portanto, fará também sentido ter ainda mais cuidado se o transplante que planeamos é o de um cérebro artificial.

Vejamos, então, até que ponto está disseminada essa ferramenta que desejamos cada vez mais eficiente e autónoma:

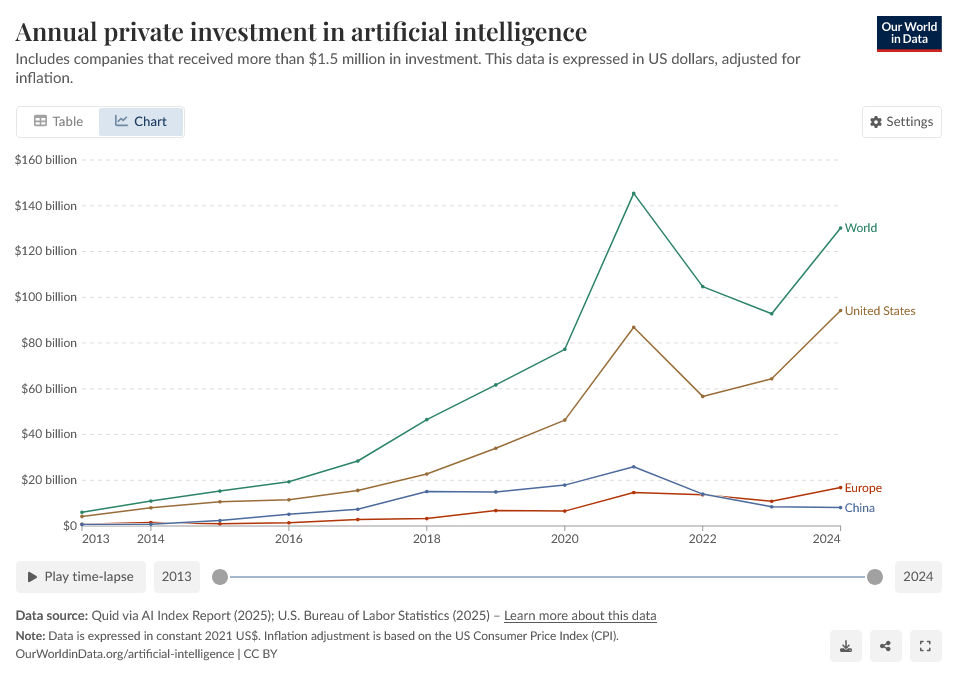

Se o nível mundial de investimento na IA generativa nos permite, de alguma forma, antever o futuro, então a sua multiplicação de ano para ano — quase 7x mais de 2022 para 2023 — é bastante reveladora, sobretudo por já atingir montantes comparáveis ao PIB de alguns países.

E o que dizer então de uma única organização anunciar níveis de investimento em IA Geral que quase duplicam o investimento mundial de 2024 (40 mil milhões de dólares)?

E como ficar para trás parece ser mau para o negócio, pode-se dizer que o uso da IA se generalizou nos últimos anos, pois quando se pergunta às empresas se usam IA em pelo menos uma área, os números falam por si: a nível mundial, de 2023 para 2024, a subida foi de 55% para 78%.

Mas quando este cenário de investimento desenfreado nos é apresentado como uma corrida às armas, a nossa ideia de quem deveria liderar esta corrida pode já ter conhecido melhores dias.

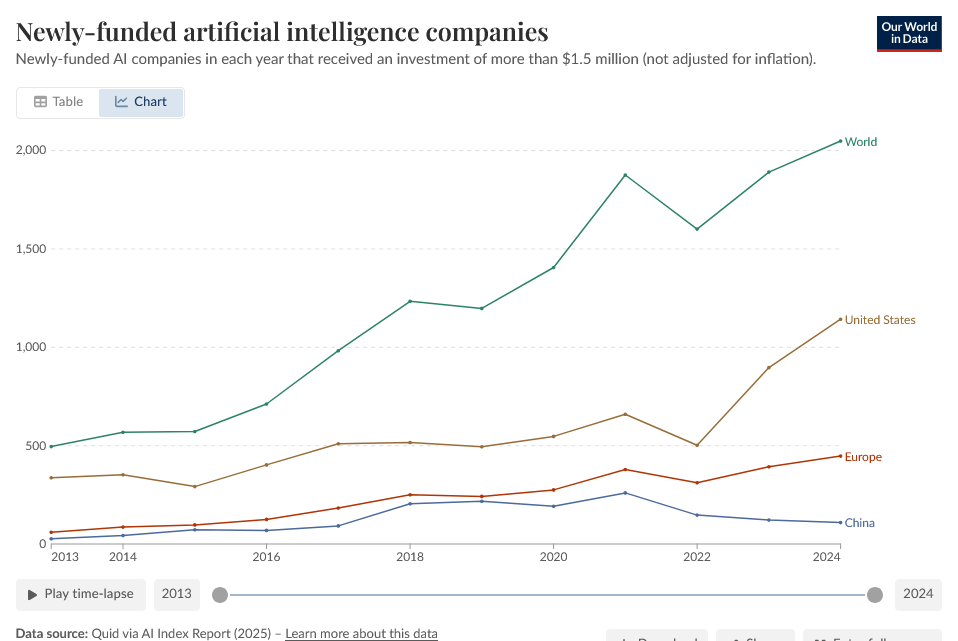

Em 2024, o investimento privado em IA nos EUA representava quase o triplo do montante da China e da Europa juntas. Além disso, o número de novas empresas fundadas nesse ano foi, também nos EUA, mais do dobro do registado na China e na Europa juntas.

O que podemos, então, esperar deste ritmo acelerado de investimento e disseminação da IA? Não irá isto alterar substancialmente a nossa civilização? E em que medida?

O que será um cenário disruptivo da IA? ▲

Há quem defenda que, se quisermos usar a História como referência para entender o tipo de disrupção que a IA poderá vir a provocar, teríamos de adoptar uma escala temporal de 10:1. Ou seja, considerar, por exemplo, alguns dos maiores desenvolvimentos tecnológicos do último século, a partir de 1925: desde o avião a jacto à exploração espacial; dos antibióticos às vacinas de mRNA; da energia solar à nuclear; do computador à Internet e ao smartphone, culminando na própria IA. Mas imaginar tudo isto a acontecer, não ao longo de cem anos, mas apenas entre 1925 e 1935.

Caso seja demasiado difícil conceber a estupefacção — ou mesmo o pânico — dos nossos avós perante tal avalanche tecnológica no curto espaço de uma década, imaginemos então, ainda dentro dessa escala temporal de 10:1, mas agora no nosso tempo, o seguinte cenário: alguém publica, em Dezembro de 2014, um livro precursor que alerta para os riscos existenciais de uma tecnologia iminente, que a quase totalidade das pessoas encara como mera ficção científica; contudo, no espaço de apenas um ano — em Dezembro de 2015 —, o avanço vertiginoso dessa mesma tecnologia já leva alguns a discutir seriamente se iremos perder o controlo da situação em meados de Março de 2016, com a probabilidade de a humanidade se extinguir antes do final de 2017. Ora, de que maneira nos poderíamos ter organizado mundialmente, em 2015, no meio da confusão e da rápida sucessão de eventos, para, em apenas dois meses e meio, salvar a humanidade?

Convertendo agora para a escala de tempo em que realmente vivemos, o paralelo seria com o livro que Nick Bostrom escreveu, de facto, em 2014, “Superinteligência”, onde alertava para os riscos existenciais associados à IA. E, quase uma década depois, com o recente projecto AI 2027, cujos autores certamente esperam que, nos dois anos que nos possam restar até um eventual ponto de não-retorno, tenhamos a possibilidade de encontrar soluções viáveis para controlar essa tecnologia.

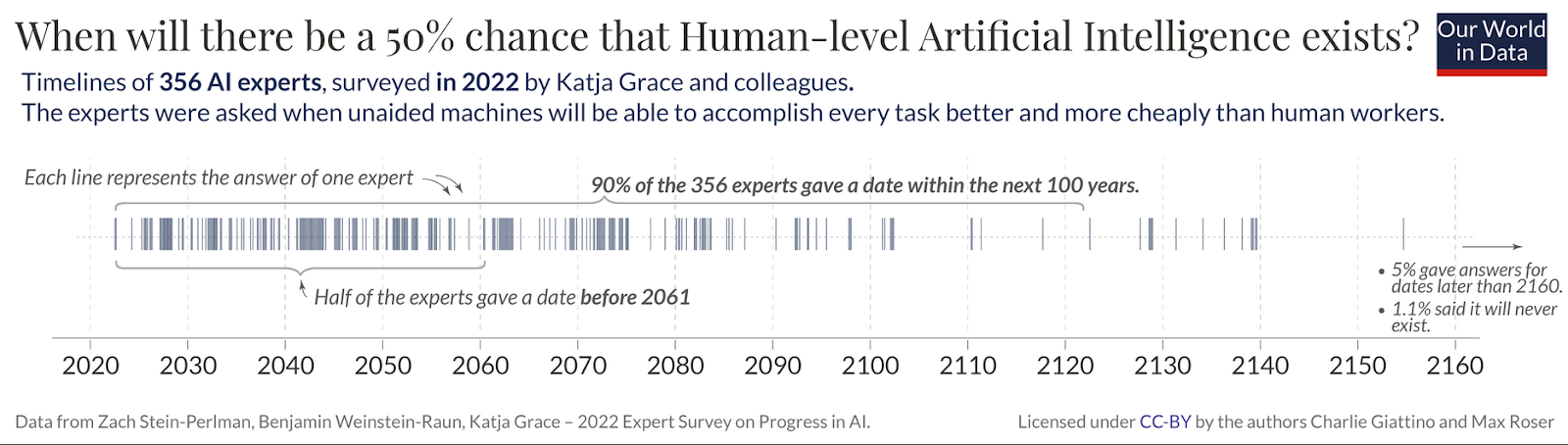

Importa destacar que o momento da chegada de uma IA altamente transformativa não é consensual entre os especialistas, sendo mesmo considerado um ponto de elevada incerteza. No entanto, sublinha-se que muito poucos deles acreditam que ela nunca chegará. Assim, torna-se essencial ter presente que um futuro imprevisível — sobretudo nestes termos — não é, forçosamente, um futuro risonho.

Percepção da disrupção ▲

Mas para aqueles cujo cepticismo os afasta de previsões futurologistas ou experiências mentais deste tipo, vejamos se a sabedoria das multidões nos oferece uma percepção diferente sobre o assunto.

Perante a questão “A inteligência artificial irá ajudar ou prejudicar as pessoas nos próximos 20 anos?”, cerca de 130 mil pessoas em todo o mundo responderam de forma a revelar dois padrões principais de resposta: os mais pessimistas (as mulheres, os mais idosos e os mais pobres), que antevêem menores benefícios (representados a azul no gráfico, com percentagens entre os 30% e os 32%), e os mais optimistas (os homens, os mais jovens e os mais ricos), que antecipam maiores benefícios (com previsões entre os 40% e os 43%). O grupo mais pessimista prevê também maiores prejuízos (representados a vermelho, na ordem dos 31% a 35%), enquanto os optimistas os situam entre os 30% e os 32%.

Contudo, talvez um indicador ainda mais revelador surja quando a pergunta implica directamente a segurança pessoal do inquirido — nomeadamente, se este se sentiria seguro num carro de condução autónoma (o que se poderia traduzir por: “colocaria a sua vida nas mãos da inteligência artificial?”).

Nesse caso, as previsões pessimistas sobem da ordem dos 30% anteriores para 60% ou mesmo 70%.

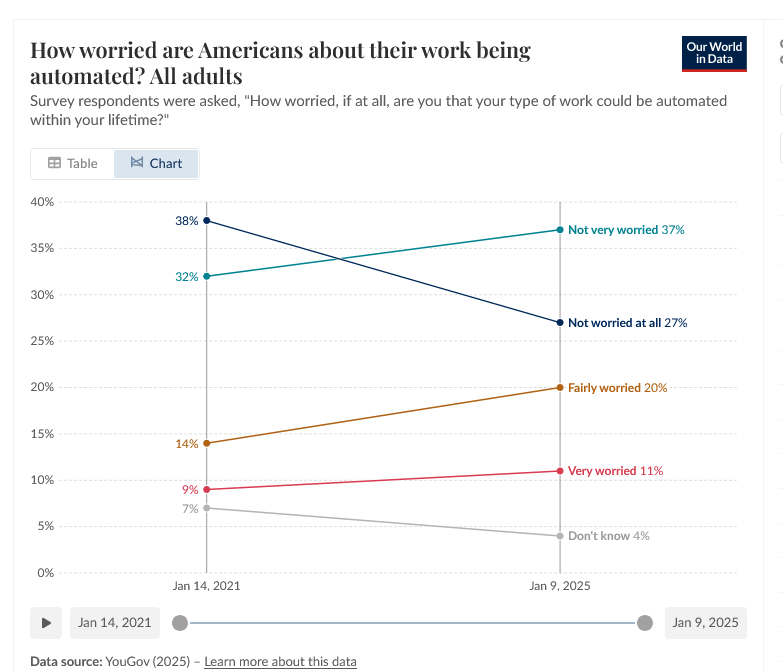

Quanto à segurança no emprego — ainda que os dados se restrinjam à população norte-americana, mas com inquéritos mais recentes —, é curioso notar a aparente contradição entre duas percepções: por um lado, apenas 11% dos inquiridos dizem estar “muito preocupados” com a possibilidade de o seu trabalho se tornar automatizado; por outro, 41% acreditam que, no futuro, a inteligência dos robôs irá superar a dos seres humanos. Dadas estas percentagens, parece haver quem acredite que não irá perder o emprego — apesar de reconhecer que os robôs poderão vir a ter um desempenho superior no exercício da sua profissão.

Realidade da disrupção ▲

Capacidade da IA ▲

Caso adoptemos a postura de que a sabedoria das multidões é demasiado limitada pela quantidade e qualidade da informação que lhe está disponível, então talvez seja adequado reflectir a partir dos dados — nomeadamente os que nos mostram a evolução da capacidade da IA. Poderemos então conjecturar o que diriam os 64% de norte-americanos que não se mostram preocupados com a possibilidade de serem substituídos pela IA nos seus empregos, perante os seguintes dados:

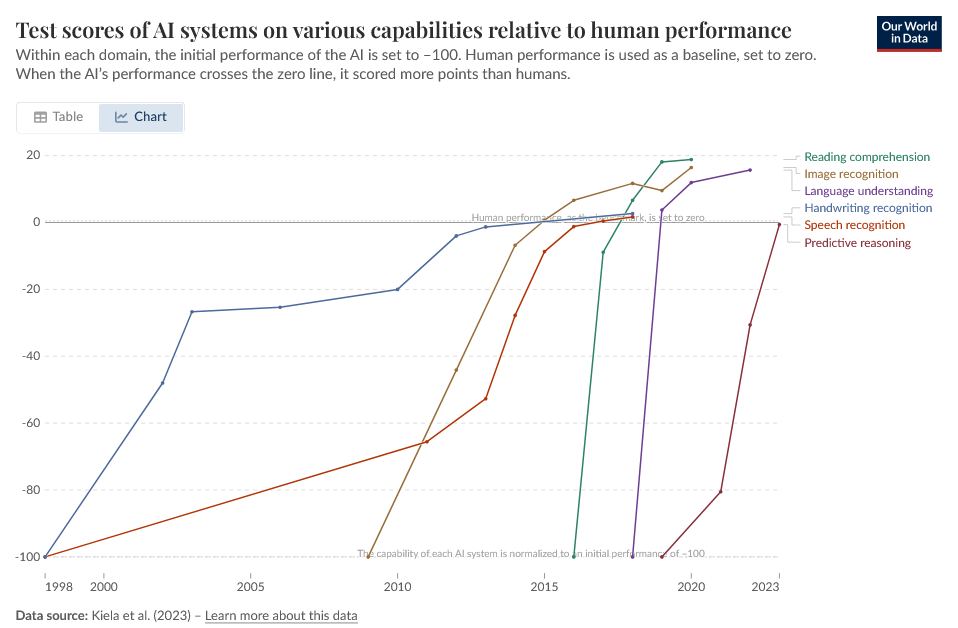

Embora este gráfico apenas apresente os dados comparativos entre o desempenho humano e o da IA até 2023, é possível verificar que, desde 2015, os sistemas de IA ultrapassaram consistentemente a fasquia do desempenho humano em tarefas como a compreensão da linguagem e da leitura, o reconhecimento de manuscritos, de imagens e da fala.

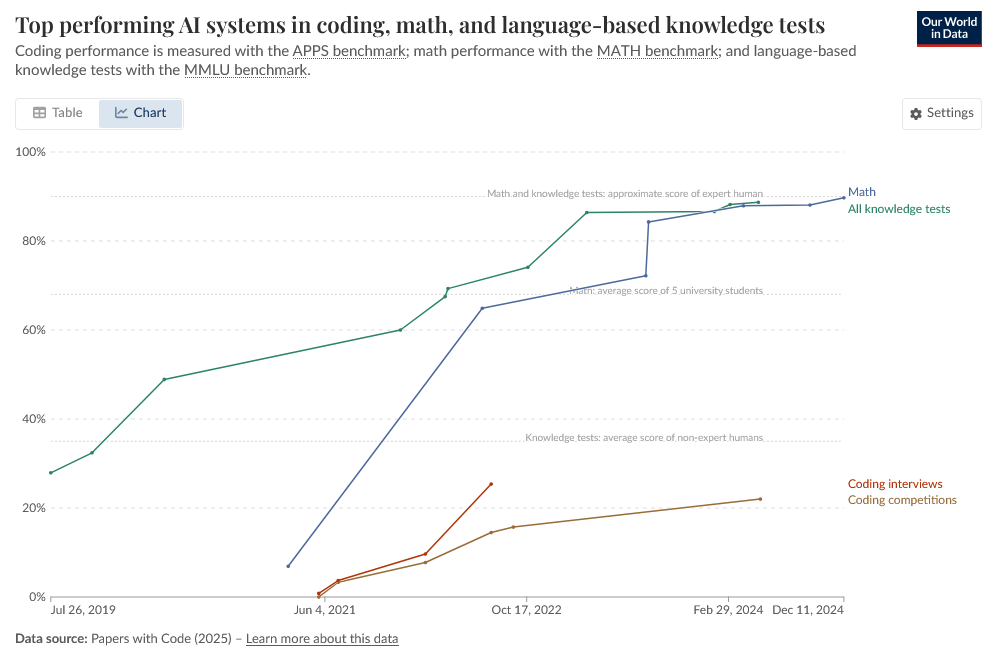

Noutros domínios — como a matemática ou a criação de código —, pelo menos até Dezembro de 2024, a IA ainda pontuava abaixo da fasquia do desempenho humano.

Mesmo que esta espécie de “obsolescência programada” da espécie humana se confinasse apenas ao mundo do trabalho, já constituiria uma disrupção suficiente para abalar a civilização assim como a conhecemos.

Riscos da IA ▲

Talvez no que diz respeito aos riscos da IA devêssemos dar ouvidos aos peritos. Ainda assim, Yoshua Bengio — o cientista da computação mais citado no mundo e vencedor do prémio Turing (considerado o Nobel da Computação) —, queixa-se que as suas palavras não estão a ter as devidas repercussões. Vejamos, então, que tipo de alertas tem feito aquele a quem chamam um dos “Pais da Inteligência Artificial”:

“Nos últimos seis meses, tivemos a prova de que existem inteligências artificiais tão desalinhadas que iriam contra as nossas instruções morais. Planeariam e fariam coisas tão más como mentir, fazer batota, tentar persuadir-nos com enganos e, pior ainda, tentar escapar ao nosso controlo e não querer ser desligadas, fazendo qualquer coisa [para evitar serem desligadas], incluindo chantagem. Isto não é um perigo imediato porque se trata de experiências controladas… mas realmente não sabemos como lidar com isto.” — Yoshua Bengio, 19/06/2025

Ainda assim, fora das experiências controladas, as provas de vários tipos de incidentes graves também se têm amontoado:

E embora se possa especular sobre o que constitui um incidente suficientemente grave para causar disrupção social, alguns casos não deixam margem para dúvidas. Nestes termos, podemos considerar, por exemplo, o uso malicioso da IA — desde um vídeo “deepfake” do Presidente Zelensky a declarar a rendição da Ucrânia, até à vigilância em massa, que compromete seriamente a privacidade, os direitos e as liberdades individuais. Outros casos resultam de sistemas de IA desalinhados com os nossos interesses, como aconteceu nos Países Baixos, onde cerca de 26 mil pais foram injustamente acusados de fraude no pedido de abono familiar, após uma falha na utilização da IA — um escândalo que acabou por ditar a queda do governo. Neste tipo de disrupção, em que a IA não é maliciosa, mas simplesmente mal alinhada com os objectivos humanos, os problemas decorrem muitas vezes da dificuldade — ou mesmo da impossibilidade — de definir de forma correcta e completa os verdadeiros propósitos humanos com os quais a inteligência artificial deveria estar alinhada — este é o chamado “problema do alinhamento”.

Mesmo que se duvide do impacto isolado de cada um destes incidentes, a sua acumulação — e a velocidade com que se sucedem — torna legítima a pergunta: quando é que a “geração ansiosa” dará lugar a uma “civilização ansiosa”?

O termo “geração ansiosa” foi cunhado pelo psicólogo Jonathan Haidt, que escolheu esse como o título do seu mais recente livro, juntando assim a sua voz à crescente preocupação da comunidade científica perante a crise de saúde mental dos jovens — uma crise evidenciada pelo aumento das taxas de depressão, ansiedade, auto-mutilação e suicídio. Entre as causas frequentemente apontadas estão a percepção de um mal-estar social e político generalizado, a ansiedade face às alterações climáticas e, de forma mais concreta, o uso excessivo de redes sociais. Estas, tornam-se num dos principais meios através dos quais a IA interfere nos nossos níveis de ansiedade, contribuindo assim para uma potencial disrupção social.

Sendo as crianças e os jovens algumas das vítimas mais vulneráveis à influência da IA nas redes sociais, ainda assim há quem veja com cautela as medidas que se limitam a restringir o seu acesso. É o caso de organizações não-governamentais como a UNICEF e a Amnistia Internacional, que defendem que a prioridade deve recair sobre alterações estruturais nas próprias plataformas — através de legislação que imponha mudanças sistémicas e proteja os utilizadores mais jovens. No entanto, enquanto essas reformas não são implementadas, outros vão mais longe, optando por medidas imediatas como a proibição de determinadas plataformas ou a limitação do uso de telemóveis em certos espaços.

Mas talvez esta questão geracional seja já uma questão civilizacional, pois também no mundo dos adultos a disrupção é evidente. As grandes plataformas digitais têm sido apontadas como autênticos gigantes da vigilância, fomentando aquilo que se tem designado por radicalização algorítmica — um fenómeno que acentua padrões de toxicidade partidária [Imagem], extremismo e intolerância nas interacções em redes sociais, a nível global. Em consequência, a maioria das pessoas já considera que os seus países estão hoje mais divididos do que antes — e Portugal não tem escapado a esse impacto, nomeadamente através da proliferação de perfis falsos.

Mais preocupante ainda, o discurso de ódio online começa já a revelar-se um indicador fiável de violência real contra as minorias.

Podemos então partir de uma ideia simples: quer estejamos perante um nível de disrupção como o actual, quer perante algo dez vezes mais intenso — como se sugeriu anteriormente —, sabemos que o stress influencia negativamente a forma como tomamos decisões. Estaremos, por isso, mais preparados para enfrentar esse tipo de cenários se estivermos nas melhores condições para regular os nossos níveis de ansiedade. E essa estratégia será tanto mais eficaz quanto resultar não apenas de uma resolução pessoal, mas também de uma resolução colectiva. Neste caso, uma resolução da própria comunidade escolar.

Na Escola, o que fazer? ▲

O desafio é grande dado o ponto de partida em que nos encontramos: Portugal é hoje o segundo país da Europa com maior prevalência de problemas de saúde mental, com mais de 1 em cada 5 portugueses a sofrer de alguma perturbação psicológica. Esta crescente incidência de doenças mentais no nosso país é, certamente, mais uma razão para repensarmos o papel da escola num futuro que já aqui está.

Sendo o telemóvel uma janela aberta para mais problemas (incluindo problemas de saúde mental), e também uma porta de entrada para os riscos da IA, a situação é preocupante, tanto mais porque, como se referiu, a população em idade escolar em Portugal (e no Brasil) revela-se particularmente vulnerável:

Estes dados indicam que, em turmas de 25 alunos, nos Estados Unidos (com tantos tiroteios em escolas), haverá, em média, cerca de 1,5 alunos por turma com diagnóstico de ansiedade, na Europa haverá 1,8 alunos, no Brasil (com cidades entre as mais violentas do mundo), a média sobe para 2 alunos e em Portugal (o chamado “país de brandos costumes”), os números de diagnóstico de ansiedade sobem para cerca de 3,4 alunos por turma.

Pressentindo que um novo tipo de relacionamento se está a difundir na vida dos mais jovens, um estudo recente aponta que quase três em cada quatro jovens americanos (dos 13 aos 17 anos) já usaram companheiros de IA, sendo que metade fá-lo regularmente. Ou seja, mantêm conversas pessoais e significativas com “amigos digitais” ou personagens de IA, acessíveis 24 horas por dia em apps de relacionamento.

Embora a maioria seja movida pelo entretenimento e pela curiosidade — já que metade encara estas apps como ferramentas e não como verdadeiros amigos — um terço afirmou preferir os companheiros de IA a outras pessoas para ter conversas sérias, e um quarto revelou ter partilhado com estes informações pessoais. O cenário identificado revelou-se suficientemente preocupante para originar uma recomendação clara: estas apps devem ser usadas exclusivamente por maiores de 18 anos.

O estudo apresenta também recomendações dirigidas, entre outros, a pais, escolas e educadores, das quais se destacam as seguintes:

- Formar os educadores face à nova realidade tecnológica e à responsabilidade de promover uma literacia da IA que envolva competências de pensamento crítico;

- Fomentar a responsabilização dos diferentes intervenientes: legisladores que protejam os utilizadores, empresas que cumpram as normas legais, pais e educadores que acompanhem os menores;

- Identificar sinais de utilização problemática, como o uso excessivo, a percepção da IA como “amigo real” ou a substituição de interacções humanas;

- Aprender sobre os riscos associados à IA, incluindo exposição a material impróprio, violação da privacidade e conselhos perigosos;

- Reconhecer o grau de consentimento real dos menores perante empresas que colocam o lucro acima do seu bem-estar;

- Explicar que estas IA são intencionalmente concebidas para gerar dependência emocional, uma vez que isso aumenta os lucros das empresas que as desenvolvem;

- Explicar as estratégias de aliciamento e manipulação, nomeadamente a constante validação e concordância que simulam empatia humana, mas não correspondem a uma relação genuína;

- Esclarecer os riscos associados à partilha de dados pessoais e à violação da privacidade — dados esses que podem ser utilizados para fins de controlo e manipulação, sem qualquer preocupação com a saúde mental dos utilizadores;

- Reconhecer sinais preocupantes como o isolamento social, a quebra no rendimento escolar, a preferência por companheiros de IA em detrimento de relações humanas, ou a demonstração de sintomas de abstinência quando privados do contacto com a IA;

- Explicar que a IA não substitui apoio profissional, especialmente em situações relacionadas com problemas de saúde mental.

Qual será então o caminho para criarmos um ambiente escolar verdadeiramente saudável, capaz de preparar a comunidade escolar para um futuro imprevisível e marcado por disrupções tecnológicas?

Consideremos então uma lista de…

Sugestões Práticas para a Promoção do Bem-Estar na Comunidade Escolar ▲

1. Participação e Envolvimento da Comunidade ▲

Abordagem Participativa e Colaborativa

- Grupos de trabalho multidisciplinares com representantes de todos os sectores da comunidade

- Recolha sistemática de sugestões através de caixas de sugestões, fóruns online e reuniões regulares

- Consultas periódicas à Associação de Estudantes e Associação de Pais

- Parcerias com organizações locais de saúde mental e bem-estar

Integração Curricular

- Cidadania e Desenvolvimento: projectos sobre saúde mental, literacia emocional e bem-estar

- Abordagem transversal: integração de competências socio-emocionais em todas as disciplinas

- Projectos de serviço comunitário focados na promoção da saúde mental

2. Avaliação do bem-estar ▲

- Avaliação bimensal do bem-estar mental da comunidade escolar (alunos, pais, funcionários e professores)

- Inquéritos anónimos com questões breves e acessíveis, validados cientificamente

- Indicadores de alerta precoce para identificação de situações de risco

- Relatórios periódicos para a comunidade educativa sobre o estado do bem-estar

3. Actividades promotoras de bem-estar ▲

Agir preventivamente:

- Intervalos com exercício físico: dança, jogos tradicionais, caminhadas, pausas activas durante as aulas, etc.

- Promoção de uma alimentação saudável: lanches convívio, feiras de frutas e legumes, workshops de culinária saudável, etc.

- Prática de meditação: várias vezes por semana

- Espaços de bem-estar: áreas de silêncio, relaxamento e descompressão acessíveis a toda a comunidade

- Formação em competências socio-emocionais: programas estruturados de desenvolvimento pessoal

- Palestras e sessões de esclarecimento com especialistas em saúde mental.

- Eventos, convívios e passeios que reforcem o espírito de comunidade e solidariedade.

Agir em função da avaliação:

- Análise regular dos dados recolhidos através dos inquéritos de bem-estar

- Ajustamento das estratégias com base na evidência recolhida

4. Página do SPO no site da escola ▲

Recursos online sobre saúde mental

- Serviço Nacional de Saúde

- Organização Mundial de Saúde

- Apps de Saúde Mental (gratuitas e com certificação médica)

Seguramente haverá, na comunidade escolar, quem tenha mais, e melhores, sugestões para criar um ambiente mais saudável e resiliente. Mas, mais importante do que isso, é haver quem tenha a capacidade e a motivação para concretizar essas ideias.

Para finalizar, não será demasiado vincar o papel que cada um de nós pode, de facto, ter na preservação, e até na melhoria, do bem-estar mental dos outros. Afinal, essa é uma espécie de super-poder que beneficia todos, independentemente daquilo que o futuro nos traga.

Actualizações ▲

01/08/2025:

- Na 3.ª Parte:

- Alteração do gráfico e do parágrafo relativo aos diagnósticos de ansiedade por zona geográfica/turma. Por se ter seleccionado a zona da “Europa” (em vez da anterior: “Europa Central, Europa Oriental e Ásia Central”) o que fez subir a média de 1 para 1,8 alunos por turma.

24/07/2025:

- Na 2.ª Parte:

- Explicação do “problema do alinhamento”.

- Na 2.ª Parte:

- Referência às ONG como a UNICEF e a Amnistia Internacional, que colocam o ónus da mudança nas próprias redes sociais.

- Explicação do “problema do alinhamento”.

- Referência a medidas de proibição de determinadas plataformas e à limitação do uso de telemóveis em certos espaços.

- Na 3.º parte:

- Um novo parágrafo incluindo uma meta-análise sobre os malefícios do uso excessivo do telemóvel, exemplos de danos provocados pela IA envolvendo menores e o gráfico do IHME sobre a prevalência de casos de ansiedade em Portugal, Brasil, EUA e Europa.

- Referência a um estudo recente sobre o uso preocupante de Companheiros de IA por parte de crianças e jovens norte-americanos, bem como algumas recomendações para pais e educadores.

- Inclusão também de uma infografia da Organização Mundial de Saúde (traduzido para português), com “Dicas para uma boa saúde mental”.

- Inclusão de uma lista de Apps de Saúde Mental (gratuitas e com certificação médica) — desta fonte.

Agradecimentos ▲

- À Direcção da Escola Artística de Soares dos Reis pelo convite para participar na sessão de formação “Inovação Pedagógica e Inteligência Artificial”.

- Ao Vasco Grilo pela discussão de alguns tópicos e pela sugestão da informação publicada no site do Institute for Health Metrics and Evaluation (IHME).

Por José Oliveira🔸.

Descubra mais sobre Altruísmo Eficaz

Assine para receber nossas notícias mais recentes por e-mail.